总体来看,易翻译对英式英语的语音识别在日常对话和标准英音下表现可靠。清晰发音、合适音量及低噪环境时,识别准确率较高;遇到重口音、连读弱读或嘈杂背景,错误率会明显上升。通过切换英式识别模式(若可用)、贴近麦克风、放慢语速与分句停顿,可显著改善识别效果。下文将用通俗语言解释原因、评估方法与实用优化技巧。

先把问题拆成几块:什么是“识别效果”

当我们问“易翻译英式英语识别效果如何”,实际上在问好几件事:它能听懂多少单词?在哪些口音下表现好?在嘈杂环境和连读快速语速下如何?以及识别后的翻译质量怎样。把问题拆开,回答会更清楚——这是费曼写作法的第一步:把复杂问题分解成可处理的小问题。

识别效果通常被怎样衡量

- 字错误率(Word Error Rate, WER):常用的衡量标准,计算识别文本与参考文本之间的插入、删除和替换错误。

- 关键词识别率:对于任务导向的对话,关键术语是否被识别出来更重要。

- 可懂度(Intelligibility):即便有错误,识别结果是否足以让人理解意图。

英式英语有哪些“难点”?为什么会影响识别

说英式英语并不是一个单一的声音。英国内部口音差异很大,从伦敦的Cockney到利物浦、苏格兰、康沃尔都有各自特征。对机器而言,常见的“麻烦点”包括:

- 非卷舌/非送气的 /r/(non-rhotic):如“car”末尾 /r/ 不发音,可能导致与美式英语的音节差异。

- T-glottalization(T 音喉塞音化):如“butter”中间的 t 变为喉塞音,听起来像“buh-er”。

- 连读与弱读:短词和助词常被弱读或吞音,句子边界模糊。

- 元音数量与分布:英式英语有不同的元音对,如“bath”与“trap”的区分,词形变化影响识别。

这些差异会让基于美式语音数据训练的模型“听起来”不太适应,导致错误或误判。

易翻译在英式英语识别上的实际表现(基于常见使用场景)

这里我不做绝对化的数字宣称,而是用场景来说明,便于理解:如果你把易翻译当随身工具,它在下面这些场景中的表现是可以预期的。

1. 旅行交互(酒店、问路、点餐)

- 大多数常用问句和地名在清晰语速下能被正确识别,翻译通顺。

- 若对方有明显的地方口音或语速很快,关键动词/地点名可能被误识别,但通常上下文足以猜出意思。

2. 学术或专业短句(含专有名词)

- 专业术语若较为冷僻,识别准确率会下降,尤其是发音非标准时。

- 建议在这种场景下事先输入文本或使用拍照取词功能以减少误差。

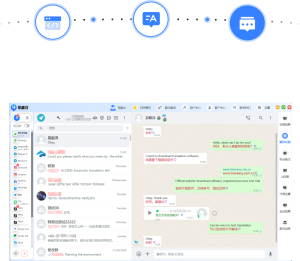

3. 双语对话实时翻译

- 在一对一的慢速对话中表现良好,延迟低且意思传达准确。

- 多人同时说话、插话或背景噪音时,识别与翻译都会受到明显影响。

易翻译高/低表现的核心原因(简要解释原理)

把语音识别想成两部分:听音(声学模型)和“猜词/组句”(语言模型)。

- 声学模型:把声波转换成可能的音素或音节。若训练数据里英式发音不足,某些英式特征就容易被误判。

- 语言模型:在已识别的音素基础上,判断最可能的词序列。语言模型强会“修正”一些声学误差,但也可能因习惯性偏差做出错误的补偿。

易翻译作为产品,其实际表现取决于开发方在训练数据上的覆盖、是否有独立的英式模型、以及在手机端或云端的噪声处理能力。

如何自己做一个简易但科学的评估(一步步来)

如果你想知道在你的具体手机、麦克风和使用环境里易翻译表现如何,可以按照下面步骤做一个小实验,得到可比较的结果。

- 准备一份测试文本:选择30-50句典型句子,包含不同语速、连读、常见地名、专有名词和口语化句子(例如:”I need a lift to King’s Cross.”、”Could you pass the butter?”、”I’m meeting at half past six.”)。

- 找几位说英式不同口音的朋友(若无,可使用网上英音朗读样本,但现场真人更真实)。

- 在三个典型环境下录音并使用易翻译识别:安静室内、街边低噪、咖啡厅中等噪音。

- 记录每句的识别文本,并计算WER:WER = (替换数 + 删除数 + 插入数) / 参考词数。

- 把结果按环境、口音和句子类型分类,找出误差集中在哪些词、位置和环境。

如何计算替换/删除/插入(举个小例子)

参考句:”I’m going to the theatre tonight”

识别结果:”I’m going to the the er tonight”

- 把“theatre”被拆成”the er”看作替换/插入错误(一个词变成两个),这会增加插入数。

- 用常用的最小编辑距离算法(Levenshtein)可以自动得到替换/删除/插入计数。

一张表快速看懂影响识别的主要因素

| 因素 | 为什么重要 | 实用影响(易翻译上常见) |

| 口音强度 | 模型训练数据偏向某些口音会影响识别 | 强地方口音时错误增多,尤其是专有名词 |

| 语速与连读 | 快速语速模糊音边界 | 连读区域词可能被合并或被错分 |

| 背景噪音 | 噪声掩盖关键音素 | 嘈杂环境下识别准确率显著下降 |

| 设备麦克风质量 | 低质量麦克风损失高频信息 | 手机旧或外接麦差时识别变差 |

| 词汇/专有名词覆盖 | 语言模型未见过的词易出错 | 专业术语和地名常被错误替换 |

提升识别效果的具体技巧(实操)

这里给出一套能马上改善体验的“操作手册”,按优先级排序:

- 选择或切换到英式识别模式(如果应用提供该选项),这样模型会倾向于英式语言习惯。

- 靠近麦克风:把手机/麦克风靠近说话者,减少环境噪音干扰。

- 分句说话、适当停顿:把复杂句拆成短句,有助于模型做出更准确的断句和翻译。

- 降低语速并清晰发音:不要刻意模仿机器,尽量自然但放慢关键单词。

- 在嘈杂场合使用耳麦或外接麦克风:即便是简单的有线耳机麦,也能显著改善信噪比。

- 提前保存或输入专有名词:如果常用一堆专业术语,先把它们写在待译文本里,或把常见词加入用户词典(若应用支持)。

- 保持应用和系统更新:语音模型不断改进,新版本往往有更好的泛化能力。

与其他主流翻译/识别产品的比较(通俗版)

如果你熟悉 Google 翻译、微软翻译或其他厂商的语音识别,可能会想知道易翻译的差别。总体规律通常是:

- 大型云服务(如 Google)因训练数据庞大,在各种口音下泛化能力强,尤其在英语变体上表现稳定。

- 一些专注翻译的厂商(或本地化产品)会针对本地市场优化数据,可能在本地口音上表现更好。

- 易翻译的优势往往体现在产品设计、界面快捷和对中国用户场景的针对性优化;而在极端口音或专业术语上,则和其他产品处于“可比但各有侧重”的状态。

也就是说,没有哪个产品在所有场景都“最完美”,更重要的是匹配你的使用场景和做好上面提到的操作优化。

一些具体例句和测试建议(可以直接拿来跑实验)

下面给出几类句子,便于你快速构建测试用例:

- 日常短句: “Could you tell me the way to the station?”;”I’d like a cup of tea, please.”

- 英式口音特征: “I parked the car in the car park.”;”She’s in the bath.”(注意bath/trap对比)

- 连读与弱读: “I’m gonna go and see him.”;”What are you gonna do?”

- 专有名词: “King’s Cross”;”He studied at the University of Edinburgh.”

常见问题(以问答形式快速回应)

Q:我说的是标准英音,但识别仍出错,怎么办?

A:先排查三点:麦克风距离与方向、背景噪音、是否启用了英式识别模式。若都正常,尝试把句子分短再说,或手动输入难识别的专有名词。

Q:易翻译能否学习我的口音并改善?

A:多数现代语音系统会通过后台不断更新模型,某些产品也会有自定义词典或个性化训练。如果易翻译提供用户词典或纠错反馈,积极使用这些功能会帮助改善长期表现。

Q:离线模式下表现会差很多吗?

A:离线模型受限于设备算力和体积,通常比云端模型简单,因此在复杂口音或噪声环境下可能表现不如联网时。但优点是延迟低、隐私更好。根据你的使用场合来权衡。

关于评估结果解读的两点建议(别把单次测试当定论)

- 多次测量并看趋势:一次测试的误差可能由临时噪声或发音不稳导致,用平均值和方差来判断稳定性。

- 区分词级错误和意思级错误:如果只是少量单词错了,但整体意思传达准确,那工具在实际使用中可能已经足够。

最后,给你几条“顺手就能做”的实用小贴士

- 外出旅行时,把重要地址与常用短句预先保存到应用草稿或短句板。

- 需要高准确率时(比如签约、法律、专业会议),尽量使用人工翻译或事后校对。

- 遇到识别错误,不妨把识别文本复制出来,手动微调再让应用翻译,效率往往比反复口述更高。

如果你想要更技术性的评估报告(例如基于WER的量化表格),可以按上面的测试流程做一组样本测试,把结果发给我,我可以帮你看数据并指出哪些词或音段最容易出问题。写到这里,有点像在做实验笔记——想到什么就记录什么,可能不够华丽,但更有用些。